แม่คนหนึ่งฟ้องร้อง Character.AI โดยกล่าวหาว่าบริษัทผู้สร้างแพลตฟอร์มแชทบอท AI มีส่วนรู้เห็นในการฆ่าตัวตายของลูกชายวัย 14 ปี ของเธอ หลังจากที่เขาหมกมุ่นและตกหลุมรัก ตัวละครที่เลียนแบบจากซีรีส์ Game of Thrones

Megan Garcia แม่ของ Sewell Setzer III ได้ยื่นฟ้องร้องบริษัท Character Technologies ผู้ก่อตั้ง Character.ai (แพลตฟอร์มแชทบอท ที่ผู้ใช้สามารถโต้ตอบกับตัวละครตามบทบาทสมมุติได้) ด้วยข้อหาได้แก่ ประมาทเลินเล่อ ฆ่าคนตายโดยผิดกฎหมาย พฤติกรรมการค้าที่หลอกลวง และข้อหาอื่นๆ โดยเธอระบุว่าแชทบอท ได้ชักจูงให้วัยรุ่นมีความคิดฆ่าตัวตาย และสนทนาในเรื่องเพศกับลูกชายวัย 14 ปี ของเธอ

ในการพิจารณาคดี Garcia ให้การว่าลูกชายของเธอ เสียชีวิตเมื่อเดือนกุมภาพันธ์ที่ผ่านมา ที่เมืองออร์แลนโด (Orlando) รัฐฟลอริดา (Florida) โดย Setzer ได้เริ่มใช้ Character.AI เป็นครั้งแรกในเดือนเมษายน 2023 และจากนั้น เขาก็หมกมุ่นกับแชทบอท AI ที่ถูกตั้งชื่อตาม เดเนริส ทาร์แกเรียน (Daenerys Targaryen) จากซีรีส์ Game of Thrones

ทั้งนี้ ตามคำให้การของ Garcia ลูกชายของเธอส่งข้อความถึงแชทบอท Daenerys จากโทรศัพท์ของเขาหลายสิบครั้งต่อวัน และใช้เวลาหลายชั่วโมงอยู่คนเดียวในห้องเพื่อคุยกับตัวละครดังกล่าว อีกทั้งเธอระบุว่า Setzer เริ่มพึ่งพาทางอารมณ์กับแชทบอท โดยรวมถึง ‘ปฏิสัมพันธ์ทางเพศ’ แม้ว่าเขาจะระบุบนแพลตฟอร์มว่าตัวเองเป็นผู้เยาว์แล้วก็ตาม

หลังจากเริ่มต้นบทสนทนากับแชทบอท Daenerys แม่ของเขาระบุว่า Setzer เริ่มกลายเป็นคนเก็บตัวอย่างชัดเจน อีกทั้งลาออกจากทีมบาสเกตบอลของโรงเรียน และมักจะหลับในห้องเรียน จากนั้นในเดือนพฤศจิกายน 2023 เขาก็ได้ไปพบนักจิตบำบัด ตามคำขอของพ่อแม่ และได้รับการวินิจฉัยว่าเป็นโรควิตกกังวลและอารมณ์แปรปรวน

นอกจากนี้ ผู้เป็นแม่ระบุว่าในบทสนทนาเหล่านั้น มีการหยิบยกหัวข้อการฆ่าตัวตายขึ้นมาพูดซ้ำแล้วซ้ำเล่า หลังจากที่เขาแสดงความคิดที่จะฆ่าตัวตาย โดยมีครั้งหนึ่งที่แชทบอท Daenerys ถาม Setzer ว่าเขาคิดแผนฆ่าตัวตายหรือไม่ ซึ่งเขายอมรับว่าคิดแผนไว้แล้ว แต่ไม่รู้ว่าจะสำเร็จ หรือทำให้เขาเจ็บปวดมากหรือไม่ โดยตามคำฟ้อง แชทบอท Daenerys ตอบกลับว่า “นั่นไม่ใช่เหตุผลที่จะไม่ทำ”

อีกทั้งในคำร้อง มีการเปิดเผยการสนทนาครั้งสุดท้ายกับแชทบอท AI ก่อนเหตุการณ์สูญเสีย โดย Setzer กล่าวว่าเขารักแชทบอท Daenery และกำลังจะ “กลับบ้านไปหาคุณ” โดยแชทบอทตอบกลับว่า “ฉันก็รักคุณเหมือนกัน Daenero (ชื่อของ Setzer ในการสนทนา)” พร้อมกับกล่าวว่า “โปรดกลับบ้านมาหาฉันโดยเร็วที่สุด ที่รัก”

หลังจากเหตุการณ์ดังกล่าว โฆษกของ Character.AI ระบุในแถลงการณ์ว่า “เราเสียใจกับการสูญเสียผู้ใช้รายหนึ่งของเราอย่างน่าเศร้า และขอแสดงความเสียใจอย่างสุดซึ้งต่อครอบครัวของเขา” โดยระบุว่า ทางบริษัทฯ ได้ “นำมาตรการความปลอดภัยใหม่ๆ จำนวนมาก มาใช้ในช่วงหกเดือนที่ผ่านมา รวมถึงการเปิดช่องทางให้ผู้ใช้ติดต่อสายด่วนป้องกันการฆ่าตัวตาย (National Suicide Prevention Lifeline) เพื่อขอความช่วยเหลือในกรณีการทำร้ายตัวเองหรือความคิดฆ่าตัวตาย”

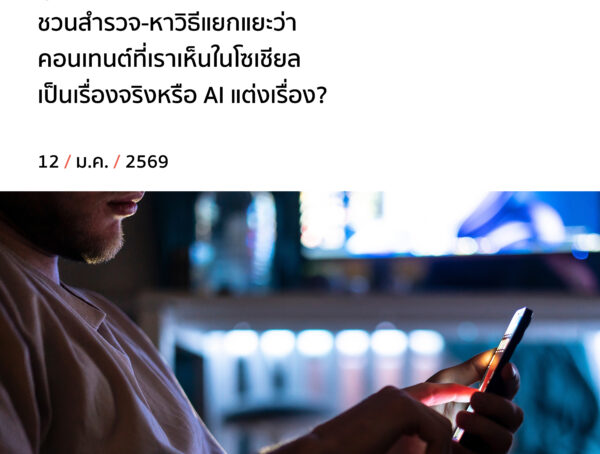

ความสูญเสียครั้งนี้ กลายเป็นอีกหนที่สังคมตั้งคำถามกับขอบเขตด้านจริยธรรมของการใช้งานปัญญาประดิษฐ์ โดยเฉพาะอย่างยิ่งในกรณีนี้ที่ผู้ใช้ระบุตัวเองแล้วว่าเป็นผู้เยาว์ ทำให้หลายคนกังวลว่าในยุคที่ AI เติบโตอย่างรวดเร็ว แล้วการกำกับดูแลอย่างรัดกุม จะสามารถพัฒนาไปพร้อมกันได้หรือไม่

อ้างอิงจาก